Les data centers sont les cathédrales invisibles de notre ère numérique. Ils hébergent nos données, font tourner nos applications et, de plus en plus, entraînent les modèles d'intelligence artificielle qui redéfinissent notre monde. Mais cette puissance a un coût, et il se mesure en térawattheures. La consommation énergétique des centres de données est devenue un enjeu écologique et économique majeur. Face à ce défi, l'ingéniosité humaine repousse les limites de la physique pour trouver des solutions de refroidissement toujours plus efficaces, nous menant des profondeurs de la terre jusqu'aux confins de l'espace.

Dans cet article, nous allons explorer en profondeur ce sujet critique. D'après notre analyse, la gestion thermique est le nerf de la guerre. Nous décortiquerons les méthodes traditionnelles, plongerons dans les innovations qui changent la donne et nous projetterons même dans un futur où nos données pourraient être traitées en orbite.

Comprendre la Consommation Énergétique d'un Data Center

Pour saisir l'ampleur du problème, il faut d'abord comprendre où part toute cette électricité. Un data center est bien plus qu'une simple collection de serveurs. C'est un écosystème complexe où chaque composant consomme de l'énergie :

- Les équipements informatiques (IT) : serveurs, systèmes de stockage, équipements réseau. C'est le cœur productif du data center.

- L'infrastructure de soutien : principalement les systèmes de refroidissement, mais aussi les onduleurs (UPS), l'éclairage et les systèmes de sécurité.

Le refroidissement représente souvent entre 30% et 40% de la consommation totale d'un centre de données. Pourquoi ? Parce que chaque watt consommé par un processeur est quasi intégralement transformé en chaleur. Sans une dissipation thermique efficace, les composants surchaufferaient et tomberaient en panne en quelques minutes.

Le PUE : L'Indicateur Clé de l'Efficacité

Pour mesurer l'efficacité énergétique d'un data center, l'industrie utilise un indicateur appelé PUE (Power Usage Effectiveness). Sa formule est simple :

PUE = Énergie totale consommée par le site / Énergie consommée par les équipements ITUn PUE parfait serait de 1.0, signifiant que 100% de l'énergie sert à alimenter les équipements informatiques, sans aucune perte pour le refroidissement ou autre. Dans la réalité, le PUE moyen mondial se situe autour de 1.5. Cependant, les géants de la tech comme Google ou Microsoft, grâce à une ingénierie de pointe, affichent des PUE impressionnants, frôlant les 1.1.

Les Solutions de Refroidissement : De la Tradition à l'Innovation

La course à un PUE plus bas a donné naissance à une multitude de technologies de refroidissement. Faisons le tour des solutions les plus marquantes, des plus classiques aux plus disruptives.

Les Méthodes Conventionnelles et Leurs Limites

La méthode la plus répandue reste le refroidissement par air. Le principe est d'organiser les racks de serveurs en allées chaudes et en allées froides. Des climatiseurs surpuissants (CRAC - Computer Room Air Conditioner) soufflent de l'air froid dans les allées froides, qui traverse les serveurs pour en extraire la chaleur, puis l'air chaud est aspiré depuis les allées chaudes pour être refroidi à nouveau. C'est une méthode éprouvée mais énergivore et peu adaptée aux serveurs modernes ultra-denses qui génèrent une chaleur intense.

Le Free Cooling : Quand la Nature Donne un Coup de Pouce

Le free cooling (ou refroidissement naturel) est une approche plus intelligente. L'idée est d'utiliser l'air extérieur lorsque sa température est suffisamment basse pour refroidir l'eau du circuit de refroidissement ou directement l'air du data center, sans avoir à faire tourner les compresseurs des climatiseurs, qui sont très gourmands en énergie. D'après notre expérience, c'est une solution très efficace, mais elle dépend fortement du climat. C'est pourquoi de nombreux data centers sont construits dans les pays nordiques, où l'air frais est abondant une grande partie de l'année.

Le Refroidissement par Immersion : Plonger les Serveurs dans le Grand Bain

Ici, nous entrons dans le domaine des technologies de rupture. Le refroidissement par immersion consiste à immerger complètement les serveurs dans un fluide diélectrique (qui ne conduit pas l'électricité) non toxique et biodégradable.

Il existe deux grandes approches :

- L'immersion monophasique : Le fluide circule autour des composants, absorbe la chaleur, puis est pompé vers un échangeur de chaleur pour être refroidi avant de revenir dans le bain. Le fluide reste toujours à l'état liquide.

- L'immersion diphasique : Le fluide a un point d'ébullition très bas (environ 50°C). Au contact des composants chauds, il se vaporise. Cette vapeur monte, entre en contact avec un condenseur froid en haut du bac, redevient liquide et retombe sur les serveurs, créant un cycle de refroidissement passif et extrêmement efficace.

Les avantages sont spectaculaires : un PUE qui peut descendre à 1.02, une densité de calcul 10 fois supérieure et une absence totale de ventilateurs, rendant les salles de serveurs étrangement silencieuses.

La Récupération de Chaleur Fatale : Transformer un Problème en Ressource

Et si la chaleur, au lieu d'être un déchet à évacuer, devenait une ressource ? C'est le principe de la récupération de chaleur fatale. L'eau chaude issue du circuit de refroidissement des serveurs peut être injectée dans un réseau de chauffage urbain pour chauffer des logements, des bureaux, des serres agricoles ou même des piscines publiques. Cette approche transforme le data center en une composante intégrée et vertueuse de l'écosystème local, participant activement à la transition énergétique. C'est un axe majeur qui influence le futur du travail et des infrastructures urbaines.

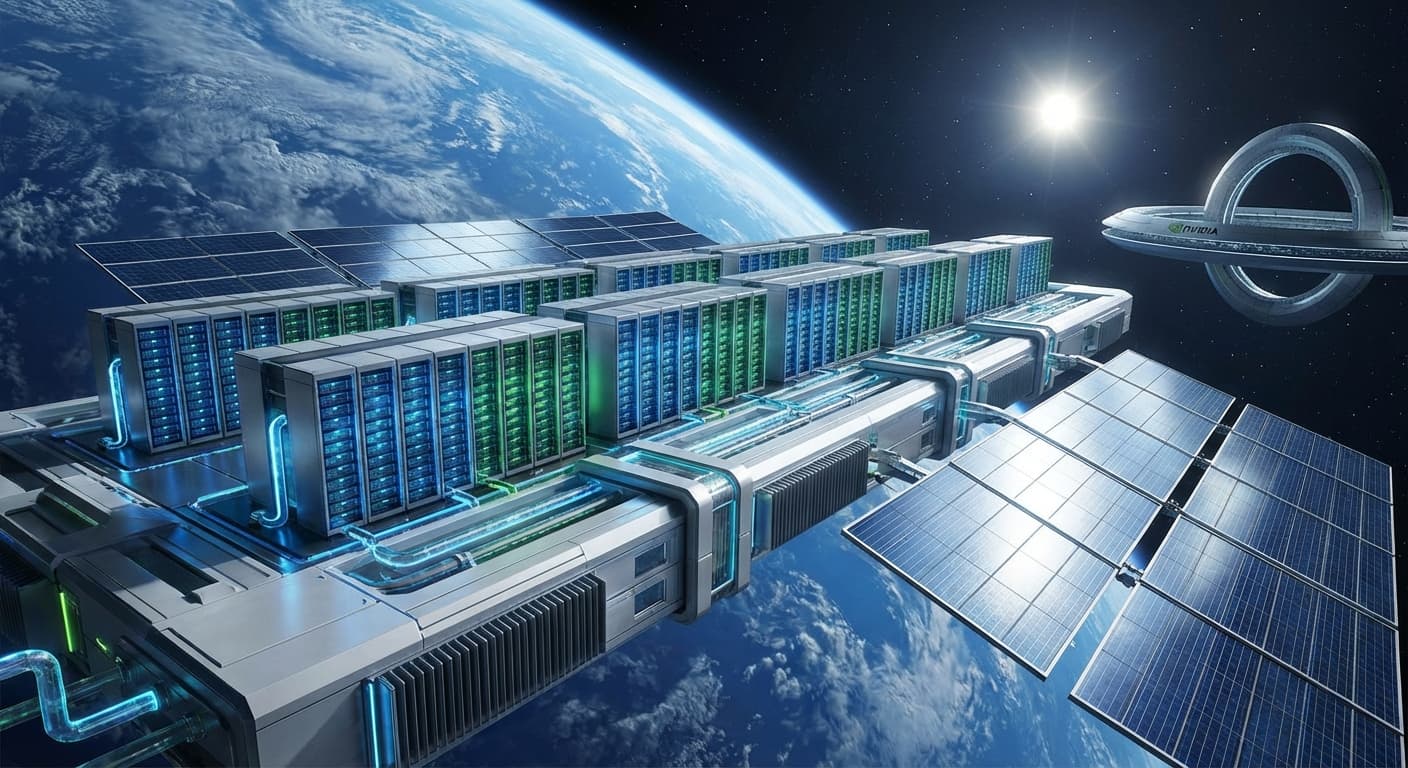

La Frontière Ultime : Le Data Center Spatial

Alors que nous optimisons chaque watt sur Terre, certains lèvent les yeux au ciel pour la prochaine grande étape. Le concept de data center en orbite, qui relevait de la science-fiction il y a peu, est aujourd'hui sérieusement étudié. Cette idée, qui s'inscrit dans la grande aventure de l'exploration spatiale, repose sur deux avantages fondamentaux de l'environnement spatial.

- Une source d'énergie inépuisable : Des panneaux solaires en orbite peuvent capter l'énergie du soleil 24/7, sans interruption due aux nuages ou à la nuit.

- Un dissipateur thermique parfait : Le vide spatial, avec sa température proche du zéro absolu (-270°C), est le meilleur radiateur imaginable.

Le Refroidissement par Radiation : La Clé du Data Center Orbital

Sur Terre, la chaleur se dissipe par conduction, convection et radiation. Dans le vide de l'espace, seuls les transferts par radiation sont possibles. Un data center spatial serait donc équipé de grands panneaux radiateurs. Ces derniers, peints avec des matériaux à haute émissivité, rayonneraient la chaleur des serveurs sous forme d'ondes infrarouges directement dans le vide glacial de l'espace.

C'est une solution d'une élégance et d'une efficacité redoutables : pas de ventilateurs, pas de pompes, pas de circuits d'eau. Juste la physique fondamentale au service de la dissipation thermique. Cette technologie spatiale de pointe pourrait permettre de créer des centres de calcul d'une puissance inimaginable, alimentés par une énergie propre et refroidis passivement.

Bien sûr, les défis sont immenses : le coût de lancement, la maintenance robotisée, la protection contre les radiations et les micrométéorites, et la latence des communications avec la Terre. Cependant, pour des tâches de calcul non-urgentes comme l'entraînement de modèles d'IA complexes ou les simulations scientifiques, le data center spatial représente une voie d'avenir fascinante et potentiellement durable.

Sources et références

Pour garantir la rigueur de cet article, nous nous sommes appuyés sur des sources reconnues et des données publiques issues d'acteurs de premier plan.

- Agence Internationale de l'Énergie (IEA) : Pour les données globales sur la consommation énergétique des data centers et les projections futures. Leurs rapports sont une référence dans le secteur.

- Google Data Centers (efficiency.google) : Google partage publiquement ses données d'efficacité, y compris le PUE de ses campus, offrant une transparence précieuse sur les meilleures pratiques de l'industrie.

- The Uptime Institute : Une organisation de référence qui fournit des standards, des certifications et des recherches sur la conception et l'exploitation des data centers.

- ADEME (Agence de la transition écologique) : L'agence française fournit des analyses et des recommandations sur l'efficacité énergétique des infrastructures numériques sur le territoire national.